Text: Martin Scheufens

Avas Blick ist gesenkt, als sie dem Mann vor ihr gesteht: »Ich will mit dir zusammen sein.« Das eigens ausgesuchte Kleid erlaubt nur am Hals einen Blick auf ihren metallenen Körper. Sie zögert, bevor sie fragt: »Willst du mit mir zusammen sein?«

Die Künstliche Intelligenz Ava aus dem Film »Ex Machina« steht für einen Menschheitstraum: ein künstliches Wesen, das denkt und fühlt. Erschaffen vom Menschen als sein Ebenbild. Eine Maschine mit Verstand, Bewusstsein, Willen, Emotionen, kurz: mit Geist.

Starke oder Allgemeine Künstliche Intelligenz nennen Forscher solche Maschinen. Bislang gibt es sie jedoch nur in Filmen und Büchern. Heutige KIs sind extrem spezialisiert, sie können nur eine einzige Aufgabe bewältigen. AlphaZero mag menschliche Meister in Go schlagen, doch »Mensch ärgere dich nicht!« ist ihm ein Rätsel, und er kann Äpfel nicht von Birnen unterscheiden. Im Alltag wäre er hoffnungslos verloren.

Ist es überhaupt möglich, Maschinen zu bauen, die sich so in der Welt zurechtfinden wie wir Menschen? Ja die sogar mit Selbstbewusstsein, Willen und Gefühlen ausgestattet sind? Welche Herausforderungen liegen vor den Entwicklern? Und wie könnte der Weg zu einer menschenähnlichen Maschine aussehen?

Der einfachste Ansatz geht scheinbar so: Man wähle ein Set elementarer menschlicher Fähigkeiten und Verhaltensweisen – etwa Sprache, Allgemeinwissen, Gefühlsreaktionen – und programmiere sie einem Computer ein. Dann wird er trainiert, sich in jeder Situation wie ein Mensch zu verhalten. Wann immer heutige Computer scheinbar menschliches Verhalten an den Tag legen, wurden sie auf diese Weise präpariert. Wenn Siri schlagfertig antwortet, dann weil ein Programmierer die Frage voraussah und Siri eine passende Antwort vorgab.

Was ist der Turing-Test?

Solch eine Maschine kann durchaus überzeugen, ja sie könnte den Turing-Test bestehen. 1950 schlug der Computer-Pionier Alan Turing vor, wie sich prüfen ließe, ob eine Maschine ein intelligentes Verhalten zeige, das mit dem des Menschen vergleichbar ist. Ein Proband unterhält sich mit einer Maschine und einem Menschen; wenn er nicht feststellen kann, wer von beiden die Maschine ist, hat sie die Prüfung bestanden.

Der Turing-Test ist populär, aber er hat ein Problem: Er prüft nicht, ob die Maschine wie ein Mensch ist, sondern nur, ob sie wie einer wirkt. Sie simuliert menschliches Verhalten, sie führt uns in die Irre. Tatsächlich ist dies schon einigen Maschinen ansatzweise gelungen. Das Chatprogramm »Eliza« mimte 1966 überzeugend einen Psychotherapeuten, indem es auf Stichworte in den Nachrichten der Probanden (beispielsweise »Familie«) mit Floskeln reagierte (»Erzählen Sie mir mehr von Ihrem Vater!«).

Auf den Chatbot »Eugene Goostman« fielen 2014 britische Probanden herein, da sie dachten, sie würden mit einem 13-jährigen Ukrainer sprechen – mangelnde Bildung und Fremdsprachkenntnisse verziehen sie deshalb. Eine Maschine müsste wohl nicht perfekt sein, um von Menschen anerkannt zu werden: Dem Menschen liegt die Neigung inne, sein Gegenüber zu vermenschlichen – wie Haustierbesitzer bestätigen können.

Ein Computer empfindet keine Trauer

Doch ein Computer empfindet keine Trauer, nur weil der Reaktionsmodus »Trauer« aktiviert wurde. Auch ist ein Taschenrechner nicht intelligent, obwohl er dividieren kann, schließlich befolgt er allein einprogrammierte Regeln, ohne zu verstehen, was er da tut. Mit dem Ansatz, intelligentes Verhalten zu simulieren, lässt sich keine »echte« Intelligenz erschaffen – mal abgesehen davon, dass die Welt zu komplex ist, als dass Programmierer jede Situation vorausahnen und einem Computer die passende Reaktion einprogrammieren könnten. Um eine Starke KI zu erschaffen, müssen Entwickler auf einer grundlegenderen Ebene ansetzen: Sie müssen jene Prinzipien entschlüsseln, die wahrhaft intelligentem Verhalten zugrunde liegen.

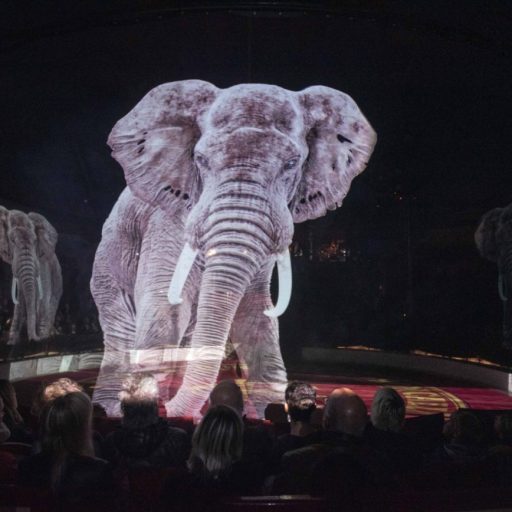

Der deutsche Dramatiker Thomas Melle schickt im Theaterstück »Uncanny Valley« seinen Roboter-Doppelgänger auf die Bühne.

Als Starke KI gilt eine Maschine, die sich in der Welt orientiert, Handlungen selbst plant und sich flexibel auf Veränderungen einstellt – so flexibel wie ein Mensch. Sie kann Menschen ähneln, kann aber auch anderen Prinzipien folgen. Eine menschenähnliche Maschine wäre noch ein weiterer Entwicklungsschritt. Hier müsste die KI eine Persönlichkeit entwickeln, die nicht nur Sätze brabbelt, sondern sie versteht, die nicht nur Regeln anwendet, sondern ihre Logik einsieht. Und die Emotionen nicht berechnet, sondern fühlt.

Was zeichnet Intelligenz aus?

Mit den Fortschritten in der KI-Forschung hat sich die Auffassung verändert, was Intelligenz eigentlich ist. Was wir im Alltag darunter verstehen, ist bloß die Spitze unserer evolutionären Entwicklung: das logisch-rationale Denken. Schach spielen, Mathematik betreiben – welcher Mensch das beherrscht, gilt als intelligent. Doch ausgerechnet diese Tätigkeiten fallen einer KI leicht, denn sie bestehen aus der Verarbeitung simpler logischer Regeln.

Was uns Menschen schwerfällt, fällt Maschinen leicht – und umgekehrt. Was wir Menschen den Maschinen voraushaben, sind solche Fähigkeiten, die wir für selbstverständlich erachten: Fahrradfahren, Small Talk führen, Freunde trösten. Für KIs sind sie bislang kaum zu meisternde Aufgaben, sie erfordern ein komplexes Wechselspiel einer Vielzahl an Kenntnissen. Zum Fahrradfahren braucht man eine sensible Wahrnehmung, schnelle Orientierung, präzise Körperbeherrschung, vorausschauendes Planen, aber auch die Möglichkeit, spontan zu reagieren. Wir beherrschen jede der Fähigkeiten auf hohem Niveau und stimmen sie zudem aufeinander ab.

Die größte Leistung des Menschen ist nicht das Schachspielen. Es ist seine enorme Fähigkeit, sich in dieser hochkomplexen Welt zurechtzufinden, sie für sich zu nutzbar zu machen und sich dabei selbst weiterzuentwickeln.

Das Leben entstand vor mehr als 3,5 Milliarden Jahren

Im Menschen wurden diese Anlagen perfektioniert, in einem evolutionären Prozess, der mit der Entstehung des Lebens vor mehr als 3,5 Milliarden Jahren begann. Diese uralten Fähigkeiten haben wir so verinnerlicht, dass sie im Unterbewusstsein ablaufen. Deswegen erscheint uns Laufen als simple Tätigkeit, obwohl unser Gehirn dabei pausenlos Eindrücke verarbeitet, Entscheidungen trifft und Befehle gibt. Ins Bewusstsein treten vor allem unsere neuesten evolutionären Errungenschaften, etwa das logische Denken oder das vorausschauende Planen. Sie finden im stammesgeschichtlich jüngsten Teil des Gehirns, dem Neokortex, statt.

Um eine Starke KI zu entwickeln, müssen Forscher nicht bei null beginnen. Als Vorbild kann ihnen das menschliche Gehirn dienen. Dieses angeblich komplexeste Objekt des Universums schafft, was die Forscher mit Künstlicher Intelligenz erreichen wollen: unbelebter Materie Geist einzuhauchen. Die Prinzipien unseres Gehirns zu entschlüsseln und in einer KI umzusetzen ist nicht der einzige denkbare Weg zu Starker KI. Intelligenz lässt sich auch anders erreichen – ein Oktopus zeigt intelligentes Verhalten, obwohl sein Nervensystem sich von unserem unterscheidet. Doch sich am Menschen zu orientieren ist besonders vielversprechend.

Das Gehirn: Vorbild für Künstliche Neuronale Netze

Nicht zufällig lieferte das Gehirn die Blaupause für den meistbeachteten Ansatz in der KI-Forschung: die Künstlichen Neuronalen Netze (KNNs). Sie sind grob der Architektur der Großhirnrinde nachempfunden. Wie diese haben sie keine starre Form, sondern bestehen aus Schichten virtueller Knotenpunkte, deren Verbindungen variabel sind. Die KNNs lernen aus Erfahrungen, aus Versuch und Irrtum. Die besten unter ihnen meistern komplexe Videospiele.

Die KNNs sind ein Meilenstein, ihre Erfolge beeindruckend. Und doch stoßen auch sie an ihre Grenzen. Um einen Apfel zu erkennen, muss ein KNN zuvor Abertausende Fotos von Äpfeln mustern. Ein Kind hingegen erkennt einen Apfel, nachdem es nur wenige Exemplare gesehen hat. Zudem büßt das KNN Fähigkeiten ein, wenn es neue erlernt. Wenn sich das Netz einer neuen Aufgabe widmet und sich ihr anpasst, löst es bestehende Strukturen auf und verliert die darin gespeicherten Informationen. Das Gehirn hingegen lernt Neues, ohne automatisch Altes zu verlieren.

Eigentlich haben wir nicht nur ein Gehirn, sondern viele

Allzu oft werden heutige Rechner mit dem Gehirn verglichen. Ein Blick unter das Gehäuse macht allerdings deutlich: Sie ähneln sich bei Weitem nicht. Zwar kommen die größten Einzelchips schon auf 35 Milliarden Transistoren – und damit nah an die 90 Milliarden Neuronen des menschlichen Gehirns –, doch jedes Neuron hat im Schnitt um die 10 000 Synapsen, also Verbindungen zu anderen Neuronen. Selbst Superrechner erreichen nicht einmal ansatzweise diese Komplexität.

Das Gehirn unterscheidet sich aber auch in seinen Grundprinzipien. Es kennt keinen zentralen Taktgeber, der alle Aktivitäten in einen Rhythmus zwingt, keine Trennung von Hard- und Software. Anders als Transistoren können Neuronen viel mehr Zustände einnehmen, als nur zu feuern oder nicht. Außerdem schwimmt das Gehirn in einem Cocktail von Substanzen, die seine Aktivität beeinflussen. Und das Gehirn ist unschlagbar energieeffizient: Während ein Supercomputer eine Leistung von mehreren Megawatt benötigt, vergleichbar dem Bedarf einer Kleinstadt, begnügt sich das Gehirn mit 20 Watt.

Die KI-Entwickler können sich also noch viel vom Gehirn abschauen. Eine der wichtigsten Erkenntnisse: Das Gehirn nutzt mehr als nur eine Strategie. Es kann »intuitiv« agieren, es kann aber auch logisch strukturiert denken. Eigentlich haben wir nicht ein Gehirn, sondern viele. Seine verschiedenen Bereiche erfüllen unterschiedliche Funktionen, sie stehen in komplexen Hierarchien zueinander. Entsprechend wird wohl nicht ein einzelner Ansatz zu einer Starken KI führen – viele verschiedene müssen kombiniert werden, etwa die klassische wissensbasierte Programmierung mit lernenden Systemen.

Könnte man Computer träumen lassen?

Weltweit arbeiten Wissenschaftler und Ingenieure daran, die Prinzipien unseres Gehirns auf Rechner zu übertragen. An der Universität Heidelberg haben Forscher den Supercomputer BrainScaleS entwickelt, der in seiner Architektur viel mehr der Struktur des Gehirns gleicht und ähnlich energieeffizient ist. Neuronen und Synapsen werden nachgebildet, dadurch sind anders als bei herkömmlichen Computern Speicher und Rechenwerk nicht mehr voneinander getrennt. Doch der »neuromorphe« Rechner befindet sich noch im Entwicklungsstadium.

Weitere Forschungsschwerpunkte sind: Wie bringt man einer KI Transferlernen bei – also die Fähigkeit, erworbene Lösungen auf andere Situationen zu übertragen? Wie lässt sich die Aufmerksamkeit einer KI auf die wichtigen Informationen lenken? Wie können Systeme ein Verständnis von Ursache und Wirkung entwickeln, um nach Erklärungen statt nur nach statistischen Zusammenhängen zu suchen? Und könnte man Computer träumen lassen, damit sie wie der Mensch im Schlaf Erinnerungen wiederholen und festigen?

Der Mensch versteht bislang nur in Ansätzen, wie sein Denkorgan funktioniert, wie die Neuronen verknüpft sind, wie Informationen verarbeitet werden, wie die Botenstoffe hineinspielen. Falls sich die Entwickler also Tricks und Kniffe vom Gehirn abschauen wollen, bedarf es noch Jahrzehnten an Forschung in der Neurologie und Kognitionswissenschaft. Dabei sind grundlegend neue Einsichten über den Ursprung von Intelligenz zu erwarten. Die KNNs waren ein Meilenstein in der Entwicklung von Spezieller KI – auf dem Weg zur Starken KI sind noch einige solcher Meilensteine nötig.

Was können KI-Forscher von Kindern lernen?

Neben der Architektur des Gehirns müssen Forscher auch verstehen, wie sich das Gehirn die Welt um sich herum aneignet. Sie interessiert daher verstärkt, wie Kinder lernen: Wie schaffen sie es, sich aus dem Chaos an Eindrücken eine Welt zu sortieren? Das Wichtige vom Unwichtigen zu trennen, Sprache zu entschlüsseln, Gesetzmäßigkeiten abzuleiten, Pläne zu entwickeln? Was lernende Systeme heutzutage können, ist lediglich ein Abklatsch davon. Was können Forscher also von Kindern für kommende KIs abschauen?

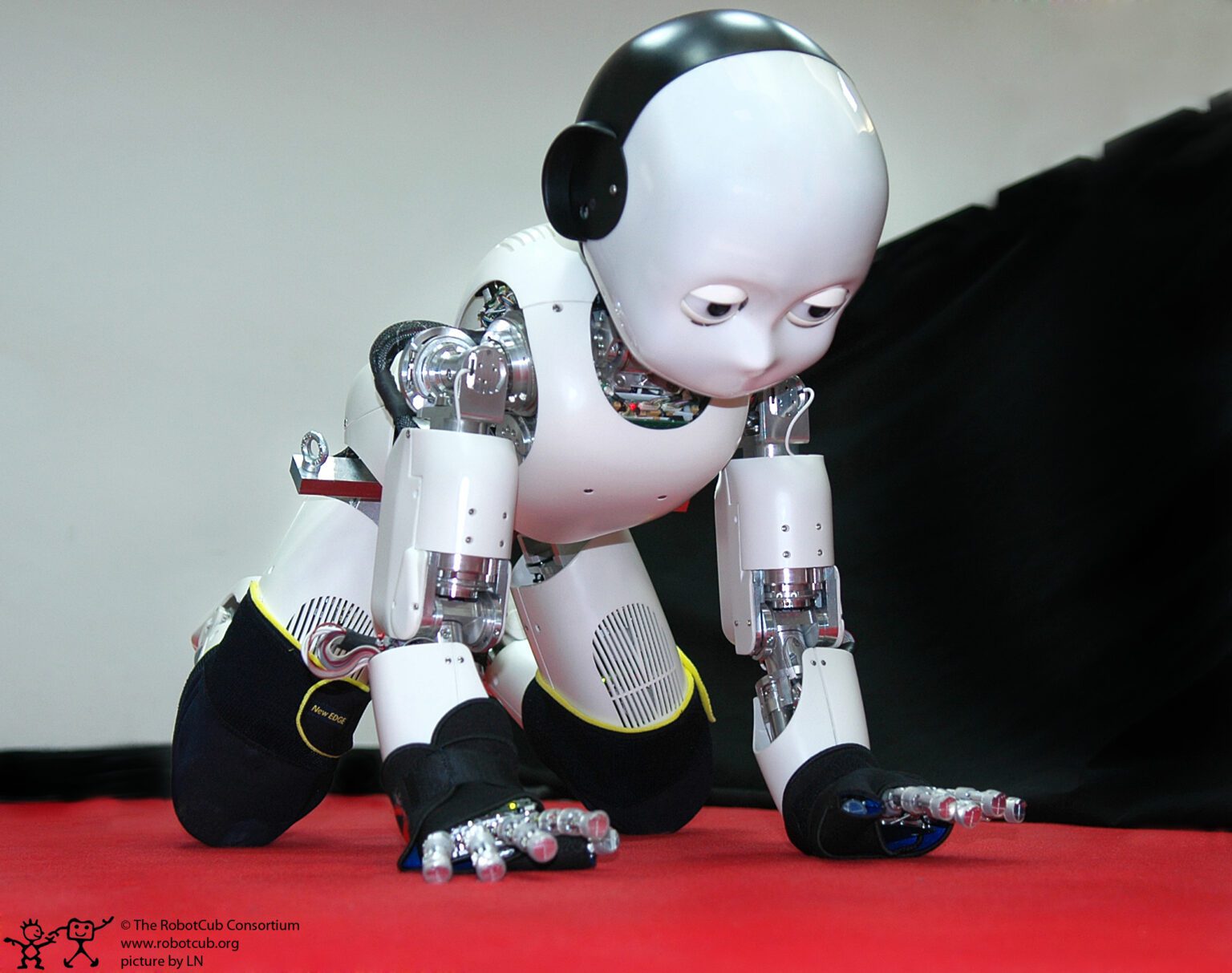

Womöglich lässt sich der Lernprozess gar nicht abkürzen, müssen KIs eine Art künstliche Kindheit durchlaufen, wie schon Turing vorschlug: Eine KI soll unterrichtet werden und lernen wie ein Kind. Sie wird in die Welt geworfen, macht eigene Erfahrungen und baut sich nach und nach ein Konzept ihrer Umwelt auf. Die Entwickler glichen dann Eltern, die die KI auf ihrem Weg begleiten.

Vielleicht entspringt aus diesem Prozess auch jenes Phänomen, das das größte Mysterium des menschlichen Geistes bildet: sein ausgeprägtes (Selbst-)Bewusstsein. Es ist wohl die Voraussetzung für einen Willen und für ein eigenständiges Verstehen. Zwar lässt sich schon heute einer KI ein »Ich« einprogrammieren, zwar kann Siri Witze über sich selbst machen oder ein Computer seinen Einfluss auf die Umwelt berechnen, doch für den Computer ist dieses »Ich« eine Variable wie jede andere. Dass er sich damit selbst bezeichnet, weiß er nicht.

Die Geburt des Ichs

Doch wenn eine KI dem Menschen gleichen soll, müsste sie sich ihrer selbst gewahr sein. Schwer vorstellbar, wie dies einem klassischen Computer gelingen soll, der als Klotz in einer Zimmerecke steht. Eine Starke KI bräuchte Sensoren, bräuchte Sinnesorgane. Ja sie bräuchte einen Körper, um in der Welt zu agieren. Zu den entscheidenden Momenten der Kindheit gehören die Wahrnehmung der eigenen – körperlichen – Grenzen, die Unterscheidung zwischen einer Außen- und einer Innenwelt und die Wahrnehmung der eigenen Wirkmacht in der Außenwelt. Vielleicht kann eine KI nur dann (Selbst-)Bewusstsein entwickeln, wenn sie ihren Platz in der Welt wortwörtlich spürt und begreift.

Wenn schließlich eine KI so aufgebaut ist wie wir, einen ähnlichen Lernprozess durchlaufen hat und dann tatsächlich so agiert wie wir, wäre es schwer zu leugnen, dass sie uns in ihren Gedanken und Gefühlen ähnelt. Wenn in der Natur unbelebte Materie echte Intelligenz hervorbrachte – warum sollte dies bei Maschinen nicht möglich sein? Spätestens dann wird uns allerdings die Frage einholen, welche Rechte den intelligenten Maschinen zuzusprechen sind.

Die Forschung an einer Starken KI – egal ob sie gelingt oder nicht – könnte für uns Menschen zum Selbsterfahrungstrip werden. Weil wir mit jedem Scheitern einer KI ein bisschen mehr über unseren eigenen Verstand lernen. Und weil wir für uns klären müssen, was uns einzigartig macht.

Der Text stammt aus dem Sonderheft P.M. Thema „Künstliche Intelligenz“.